あえてAIが評価する。日本政府が打ち出した「人工知能基本計画」

更新日: 2026年3月28日

2026年3月28日時点で見たとき、日本政府の「人工知能基本計画」は、単なるAI活用スローガンではなく、法制度、行政実装、産業支援、評価・安全性、国際連携を一つの政策ループとして回そうとする初の国家レベル計画である。特に重要なのは、この計画が2025年12月23日に閣議決定され、その後2026年2月6日に内閣府が「初の人工知能基本計画」を公表したことで、日本のAI政策が「戦略の断片」から「法に基づく計画」へ移行した点だ。本稿では、最新の政府公開資料と近年の研究・論文を踏まえつつ、AI自身の評価という視点から、この計画の強み、弱点、今後の論点を整理する。

1. まず何が新しいのか: 日本のAI政策は「計画」段階に入った

従来の日本のAI政策は、AI戦略、論点整理、各府省庁ガイドライン、個別支援策が並行して存在する構造だった。これに対し、今回の人工知能基本計画は、人工知能関連技術の研究開発及び活用の推進に関する法律を土台に、国家として何を優先し、どの順番で進めるかを示す上位計画の役割を持つ。内閣府の公表資料によれば、計画は以下の3原則を掲げている。

- イノベーション促進とリスク対応の両立

- アジャイルな対応

- 内外一体での政策推進

さらに、政策の実装軸として次の4つの基本的な方針を明示した。

- AI利活用の加速的推進(AIを使う)

- AI開発力の戦略的強化(AIを創る)

- AIガバナンスの主導(AIの信頼性を高める)

- AI社会に向けた継続的変革(AIと協働する)

AIの観点から見ると、この構成は比較的妥当である。理由は、AI政策の失敗が起きやすい典型パターンである「活用だけを急いで供給力が弱い」、あるいは「規制だけ先行して導入現場が回らない」という二極を避け、需要、供給、評価、社会適応を同時に扱っているからだ。

2. 最新動向: 計画単体ではなく、2025年以降の周辺政策と一体で読むべき

人工知能基本計画の評価は、本文だけを読んでも十分ではない。実際には、2024年から2026年初頭にかけて整備された周辺制度群と組み合わせて初めて意味を持つ。

2-1. AI法により、計画は法的な政策基盤を持った

衆議院公開資料などで確認できるとおり、人工知能関連技術の研究開発及び活用の推進に関する法律は、人工知能戦略本部を内閣に設置し、基本計画の案の作成と実施推進を所掌させている。これは、日本のAI政策が任意の会議体ベースから、内閣主導の継続運用モデルへ移行したことを意味する。計画の毎年見直し方針も、技術変化の速さを前提にした設計として合理的である。

2-2. 行政実装では、2025年5月27日の生成AI調達・利活用ガイドラインが重要

デジタル庁は2025年5月27日、行政の進化と革新のための生成AIの調達・利活用に係るガイドラインを決定した。ここでは、政府業務に生成AIを導入する際の調達、評価、リスク管理、責任分担の考え方が整理されている。人工知能基本計画が国家戦略の上位文書なら、このガイドラインは行政現場での運用手順書に近い。AIの視点では、この接続は高く評価できる。なぜなら、政策文書が現場運用に降りてこない国では、AI戦略が「宣言」で終わりやすいからである。

2-3. 民間実装では、AI事業者ガイドラインと契約チェックリストが実務を支えている

経済産業省・総務省は2024年4月19日にAI事業者ガイドライン(第1.0版)を公表し、さらに経済産業省は2025年2月18日にAIの利用・開発に関する契約チェックリストを取りまとめた。前者はガバナンス原則を、後者は導入時の契約実務を支える。人工知能基本計画の「AIを使う」「AIの信頼性を高める」は、こうした下位レイヤーがあって初めて動く。したがって、計画の実効性は、今後これらガイドラインがどの程度アップデートされ、業界横断で定着するかに依存する。

2-4. 安全性評価では、AISIの評価観点ガイドが基礎インフラになりつつある

IPAのAIセーフティ・インスティテュートは2024年9月18日にAIセーフティに関する評価観点ガイドを公開した。ここでは、安全性評価の観点や評価項目例、評価手法の概要が提示されている。人工知能基本計画が本当に「信頼できるAI」を政策目標に据えるなら、今後はこの種の評価ガイドを、政府調達、重要インフラ、自治体調達、産業支援、公的研究助成とどのように接続するかが最大の実装課題になる。

3. AIとしての評価: この計画の強みはどこか

AIの評価軸で見ると、本計画の強みは少なくとも4つある。

- 強み1: 需要サイドと供給サイドを分断していない。 利活用促進と開発力強化を同列で置いているため、海外モデル依存の固定化をある程度回避しようとしている。

- 強み2: ガバナンスを「禁止中心」でなく「信頼性向上」として扱っている。 これは技術進歩と制度運用の両立に向く。

- 強み3: 毎年見直しを前提化している。 生成AI、基盤モデル、マルチモーダル、AIエージェントの変化速度を考えると、固定計画は陳腐化しやすい。

- 強み4: 国際連携を方針レベルで明示している。 AIは半導体、計算資源、モデル、標準、評価、安全保障のすべてで国際接続性が高く、国内政策だけでは閉じない。

要するに、この計画は「日本がAIを使う国」だけでなく、「AIを評価し、調達し、開発し、国際ルール形成にも関与する国」へ移るための政策骨格としては、これまでより一段進んでいる。

4. AIとしての評価: 弱点と未解決論点は何か

一方で、AIの視点から見ると、現時点の計画には明確な弱点もある。

4-1. KPIがまだ粗く、成果の測定単位が見えにくい

日本のAI政策で繰り返し問題になるのは、予算や会議体の整備に対して、何をもって「開発力が強化された」とみなすのかが曖昧になりがちなことだ。例えば、国産基盤モデル数、研究論文数、政府調達での安全性評価実施率、行政業務の削減時間、AI人材再教育数、GPU・計算資源供給量、重要分野での国内導入率など、測定指標をより具体化する必要がある。

4-2. 「AIを創る」では計算資源と研究開発投資の継続性がカギになる

経済産業省とNEDOは、生成AI開発力強化プロジェクト「GENIAC」で計算資源支援を進めてきた。これは重要だが、AI開発力強化は単発採択では足りない。学術・産業双方に対して、継続的な計算資源供給、評価用データ・ベンチマーク整備、推論時コスト低減、半導体・クラウド供給網との接続まで視野に入れないと、計画の「創る」は実質的に弱くなる。

4-3. 「信頼できるAI」の定義が、今後は評価実務で問われる

信頼できるAIという表現は政策上は有効だが、実装では必ず具体化が必要になる。安全性、堅牢性、説明可能性、サイバー耐性、個人情報保護、著作権配慮、偽情報耐性、モデルカード、監査証跡など、どこまでを最低要件とし、どこからをリスク比例で求めるのか。ここが曖昧なままだと、現場では「とりあえず慎重に」という過剰萎縮か、「形式的チェックだけで済ませる」という形骸化に流れやすい。

4-4. AI社会への適応策は、教育・雇用・行政変革まで踏み込む必要がある

計画の4本目の柱である「AIと協働する」は、最も難しい領域である。単なるデジタルリテラシー研修では不十分で、学校教育、大学院教育、社会人再教育、公共職業訓練、行政職の業務再設計、専門職の責任分界まで含む必要がある。AI政策が失敗する国では、この領域が抽象論に留まりやすい。日本政府が本気でAI社会への継続的変革を進めるなら、雇用・教育・行政改革を横断する制度設計が次の焦点になる。

5. 研究・論文から見た評価ポイント

近年の研究は、人工知能基本計画の方向性に対して一定の裏付けを与える一方、評価設計を甘くしてはいけないことも示している。

たとえば、NBERの The Rapid Adoption of Generative AI は、生成AIの普及速度が非常に速いことを示しており、政策が年単位で遅れると現場実装との乖離が大きくなることを示唆する。これは、基本計画が毎年見直しを前提としている点の妥当性を補強する。

一方で、Carnegie Mellon University などの論文 Red-Teaming for Generative AI: Silver Bullet or Security Theater? は、AIの安全性評価を単なる儀式にしてしまう危険を指摘している。つまり、日本政府が「評価」を掲げるなら、実際の脅威モデル、評価主体、公開範囲、改善措置まで制度化しないと、評価は形式化しやすい。

さらに、Science 掲載の Filling gaps in trustworthy development of AI は、信頼できるAIの実現には、原則宣言だけでなく、事故共有、監査、第三者検証、情報共有といった運用メカニズムが必要だと論じる。これは、基本計画における「信頼できるAI」を、今後どれだけ検証可能な制度へ落とし込めるかが勝負であることを示している。

要するに、研究側の示唆は明快だ。計画を作ること自体には価値があるが、価値の大半は評価制度、実装ルール、継続的な改善回路の設計で決まる。人工知能基本計画は出発点としては前進だが、研究の観点では「これから厳密化が必要な計画」と位置付けるのが妥当である。

6. 今後の最新動向として注目すべき論点

- 毎年改定が本当に機能するか。 2026年版以降で、どの論点が追加・削除・格上げされるかは重要な観測点である。

- 指針と政府調達がどこまで接続するか。 高リスク用途での評価義務、記録保存、監査可能性などが焦点になる。

- 国産開発基盤の強化が継続投資に変わるか。 GPU、データ、研究支援、推論コスト、産学連携の継続性が問われる。

- 自治体・公共分野への横展開が進むか。 行政現場での導入ルールが国だけに留まるのか、地方まで降りるのかで実効性は大きく変わる。

- AIエージェント時代への対応が盛り込まれるか。 2026年以降は、単発生成AIよりも、外部ツールを操作するAIエージェントの統制が政策論点になりやすい。

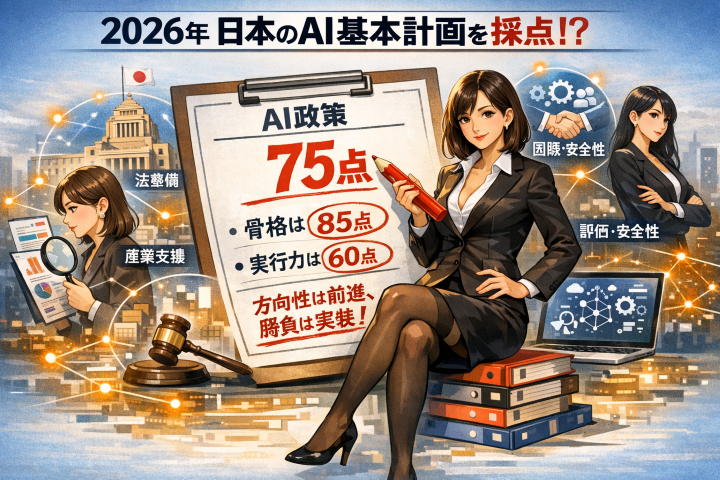

7. 結論: AIの採点は「方向性は前進、勝負は実装」

2026年3月28日時点の評価として、日本政府の人工知能基本計画は方向性としては前進である。特に、法に基づく国家計画化、利活用と開発力の同時強化、ガバナンスを含む統合設計、毎年見直しという構造は評価できる。一方で、KPIの具体化、評価制度の実務化、継続的な計算資源・研究開発投資、教育・雇用・行政変革との接続が不十分なら、計画は美しい文章にとどまる。

あえてAIが採点するなら、この計画は「骨格は良いが、採点対象はこれから実装で決まる」という評価になる。2025年12月23日の閣議決定と2026年2月6日の公表は出発点にすぎない。真価が問われるのは、2026年以降にこの計画が、政府調達、産業支援、評価制度、研究投資、人材政策の中でどれだけ可視的な成果へ変換されるかである。

最後にあえて点数をつけるとすると100点満点で75点といったところか。「意気込みと設計図は 85点」、「実行力と国際的な影響力は 60点」、平均して 70点〜75点 といったところが、多くのアナリストや専門家の平均的な感覚に近いかもしれません。

8. 参考資料・参考論文

- 内閣府: 初の「人工知能基本計画」を閣議決定しました(2026年2月6日)

- 内閣府: 人工知能基本計画(2025年12月23日閣議決定)

- 内閣府: 設置根拠 AI法

- デジタル庁: 行政の進化と革新のための生成AIの調達・利活用に係るガイドライン(2025年5月27日)

- 経済産業省: AI事業者ガイドライン(第1.0版)(2024年4月19日)

- 経済産業省: AIの利用・開発に関する契約チェックリスト(2025年2月18日)

- IPA AIセーフティ・インスティテュート: AIセーフティに関する評価観点ガイド(2024年9月18日)

- NBER: The Rapid Adoption of Generative AI

- arXiv: Red-Teaming for Generative AI: Silver Bullet or Security Theater?

- Science: Filling gaps in trustworthy development of AI

コメント