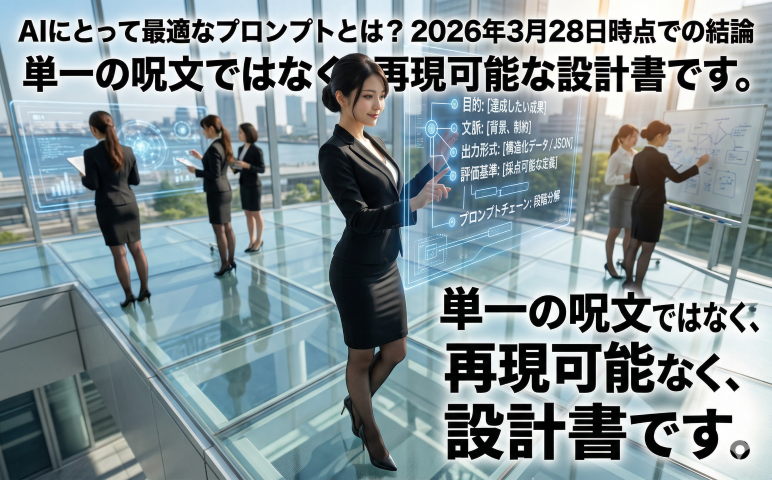

AIにとって最適なプロンプトの作り方とは?

2026年3月28日時点での結論を先に述べると、AIにとって最適なプロンプトとは、気の利いた一文ではなく、目的・文脈・制約・出力形式・評価基準を明示した再現可能な設計書です。2024年から2025年にかけての研究と実務の最新動向では、単発の“魔法の呪文”を探す発想から、プロンプトを実験し、分割し、評価し、最適化する発想へと急速に移行しました。

特に最近は、推論能力の高いモデルや長文コンテキスト対応モデルの普及により、単に「詳しく答えて」と頼むよりも、役割、入力データの境界、望ましい出力スキーマ、禁止事項、採点基準を明確化する方が、品質・安定性・安全性の面で大きな差を生みます。さらに、研究コミュニティでは自動プロンプト最適化が進み、実務ではプロンプトをコードや評価セットと一緒に管理する運用が主流になりつつあります。

なぜ今、プロンプト設計が変わっているのか

以前は、few-shot や chain-of-thought のような代表的手法を覚えることが中心でした。しかし現在は、モデル自体の能力向上とツール利用の一般化によって、プロンプト設計の焦点が次の3点へ移っています。

- 1. 指示文の巧拙よりも、タスクの分解と評価設計が重要になった

- 2. 長文文脈を前提に、資料配置や区切り方が性能を左右するようになった

- 3. 自動最適化や継続的評価により、プロンプトを“勘”でなく“改善対象”として扱う流れが強まった

Anthropic の公式ドキュメントでは、複雑な作業は1本の巨大なプロンプトで処理するより、プロンプトチェーンとして段階分解した方が精度・追跡性・保守性が高いと整理されています。Google の Gemini 公式ガイドも、曖昧な依頼より、明示的な指示、制約、例示、構造化された出力指定を伴う設計を推奨しています。OpenAI 側でも、モデル任せではなく、期待出力を具体化し、必要なら構造化出力で拘束する方向が強まっています。

2025-2026年時点の実務ベストプラクティス

1. まず「何を成功とみなすか」を書く

最適なプロンプト作成で最初にやるべきことは、文面の工夫ではなく成功条件の定義です。たとえば、要約タスクなら「300字以内」「固有名詞を落とさない」「推測を書かない」、抽出タスクなら「JSONで返す」「未確認項目は null にする」のように、採点可能な形に落とします。これがないと、どのプロンプトが優れているか比較できません。

2. 入力と命令の境界を明示する

最新の実務では、プロンプト本文の中に、指示、参照資料、出力条件を混在させないことが重要視されます。XML風タグ、Markdown 見出し、区切り記号などで境界を明示すると、モデルがどれを命令として解釈し、どれを参照情報として扱うべきかが安定します。これは長文コンテキスト時代に特に重要です。

3. 出力形式を自然言語ではなく“仕様”として書く

「表でまとめて」だけでは不十分です。列名、型、件数上限、禁止表現、例外時の返答まで指定します。近年は JSON Schema や厳格なフィールド指定を使って、出力の揺れを抑える運用が一般化しています。これは記事生成だけでなく、RAG、業務自動化、エージェント設計で特に有効です。

4. 1本で解かず、段階処理に分ける

最新トレンドでは、調査、抽出、検証、整形を1回の生成に押し込まず、複数プロンプトへ分解する方法が重視されています。たとえば、論点抽出 → 根拠確認 → 下書き生成 → ルール照合のように段階化すると、誤答の原因が追跡しやすくなり、修正もしやすくなります。これは prompt chaining として各社公式ガイドでも推奨される考え方です。

5. “長いほど良い”ではなく、長文は整理して置く

長いコンテキストが使えるからといって、資料を無秩序に詰め込むと性能は安定しません。最近の実務知見では、重要文書を先頭付近に置く、質問を最後に置く、参照箇所を明示するといった配置が有効です。長文運用では、情報量より情報設計が重要になります。

6. 評価セットと一緒に改善する

最適なプロンプトは、1回で完成させるものではありません。少数でもよいので代表ケース、失敗しやすいケース、境界ケースを含む評価セットを作り、同じ条件で比較するのが現在の標準的な進め方です。2025年以降は、プロンプト改善を“文章の推敲”ではなく、評価付きの反復最適化として扱う傾向がさらに強くなっています。

研究から見た重要論点

プロンプトは依然として性能を大きく左右する

2022年の Large Language Models Are Human-Level Prompt Engineers は、LLM に候補プロンプトを生成させて探索する APE(Automatic Prompt Engineer)を提案し、人手設計に匹敵する、あるいは上回るケースを示しました。この流れは、その後の自動最適化研究の起点の1つになりました。

2023年の Large Language Models as Optimizers(OPRO)は、LLM 自身を最適化器として使い、スコアを見ながら次のプロンプト候補を改善していく枠組みを提示しました。これは、プロンプト設計を静的な作文ではなく、探索問題として扱う代表例です。

最新研究は“短い指示”から“長い実運用プロンプト”へ進んでいる

2024年 ACL Findings の Automatic Engineering of Long Prompts は、実務で使われるような数百〜数千トークン級の長いプロンプトを自動改善する難しさに正面から取り組んでいます。研究テーマが短文命令の最適化から、現場で本当に使われる長文・複合プロンプトへ移っている点は重要です。

“手法の名前を覚える”だけでは足りない

2024年の大規模サーベイ The Prompt Report は、膨大な文献を整理し、プロンプト技法の語彙と分類を体系化しました。ここから分かるのは、few-shot、self-consistency、decomposition、retrieval augmentation などの個別技法は重要である一方、実際の品質を決めるのはタスクとの適合と評価方法だということです。つまり、最適なプロンプトに普遍的な単一解はなく、目的依存であるという理解が、現在の研究側の共通認識に近づいています。

2025年は自動プロンプト工学の整理が進んだ

2025年のサーベイ A Survey of Automatic Prompt Engineering: An Optimization Perspective では、自動プロンプト工学が、探索空間、最適化戦略、評価方法、計算コストといった観点で整理されています。これは、プロンプト改善が職人的ノウハウから、より工学的で比較可能な対象へ移行していることを示します。特に企業利用では、人的な試行錯誤だけでなく、ログ・評価・自動探索の組み合わせが重要になる流れが読み取れます。

見落とされがちな最新動向

1. 最適プロンプトは“単体の文”ではなく“システム設計”である

現在の高品質な AI 活用では、プロンプトは単独で存在しません。モデル選択、ツール使用、検索、メモリ、構造化出力、再試行、検証などと結びついています。したがって「最高の一文」を探すより、「どこで検索し、どこで検証し、どこで整形するか」を含めて設計する方が成果につながります。

2. セキュリティとプロンプト注入対策が不可欠になった

外部文書やユーザー入力を読むシステムでは、参照データ内に悪意ある命令が埋め込まれる可能性があります。そのため最新実務では、命令とデータの分離、高権限操作前の確認、許可されたツールのみの実行、出力検証が必須です。良いプロンプトは、精度だけでなく安全性も含めて設計されます。

3. 推論モデル時代は“考えさせ方”より“制約の与え方”が重要

近年の高性能モデルは、内部推論能力が高いため、ユーザーが過度に思考手順を細かく指定しなくても成果を出せる場面が増えました。その一方で、何を出力すべきか、何をしてはいけないか、評価基準は何かを曖昧にすると、出力のぶれは依然として大きくなります。したがって、最新の最適化ポイントは“思考の代行”より“境界条件の明示”に寄っています。

すぐ使える実践テンプレート

あなたの役割: [専門家の役割]

目的: [達成したい成果]

入力データ: [対象データ]

制約: [禁止事項、文字数、観点、参照範囲]

出力形式: [HTML / JSON / 表 / 箇条書き などを厳密指定]

評価基準: [正確性、網羅性、根拠、簡潔性など]

不足情報がある場合: [推測せず確認 / null を返す など]

このテンプレート自体が万能なわけではありませんが、少なくとも「目的」「材料」「制約」「形式」「採点軸」が欠けていないかを確認するチェックリストとして有効です。最適なプロンプトとは、モデルを感覚で操る技術ではなく、曖昧さを減らし、再現性を高める設計技法です。

結論

AIにとっての最適なプロンプトの作り方は、2025年から2026年にかけて明確に進化しています。最重要ポイントは、うまい言い回しを探すことではなく、タスクを構造化し、出力を仕様化し、評価しながら反復改善することです。研究面では自動プロンプト工学が進み、実務面ではプロンプトチェーン、長文コンテキスト設計、構造化出力、安全対策が中心テーマになっています。これからのプロンプト設計は“職人芸”ではなく、“運用可能な設計と改善のプロセス”として捉えるのが最も実践的です。

参考情報

- OpenAI Docs: Key concepts / prompt engineering guide 参照入口

- Anthropic Docs: Chain complex prompts for stronger performance

- Google AI for Developers: プロンプト設計戦略

- Large Language Models Are Human-Level Prompt Engineers (2022)

- Large Language Models as Optimizers (2023)

- The Prompt Report: A Systematic Survey of Prompt Engineering Techniques (2024)

- Automatic Engineering of Long Prompts (ACL Findings 2024)

- A Survey of Automatic Prompt Engineering: An Optimization Perspective (2025)

コメント