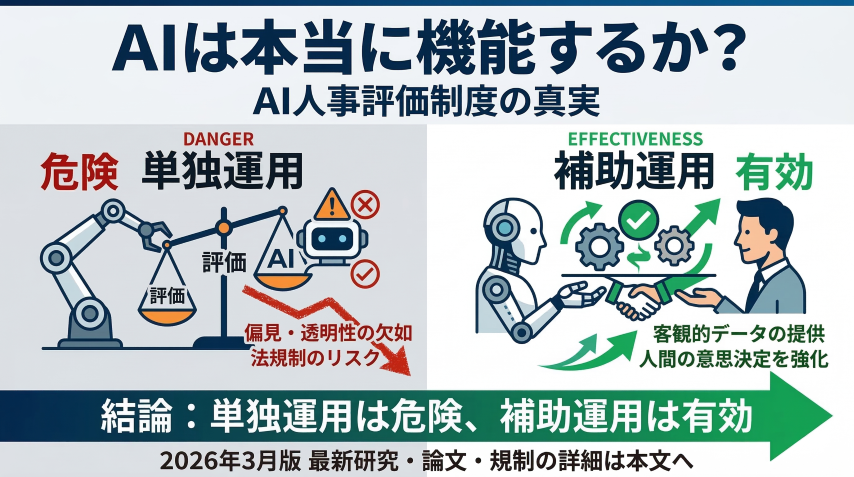

本当にAIが作った人事評価制度は機能するか? 2026年3月版 最新研究・論文・規制から見る「単独運用は危険、補助運用は有効」という結論

公開日: 2026-03-12

本稿は、2026年3月12日時点で確認できる最新の研究論文、制度文書、国際機関レポートをもとに、「AIが作った人事評価制度は本当に機能するのか」を検証する記事です。ここでいう「AIが作った人事評価制度」とは、AIが評価項目、目標、配点、コメント、昇進候補、要注意者フラグ、将来評価予測などを自動生成または自動推奨し、その内容が人事評価の実務に直接使われる仕組みを指します。

先に結論を述べると、AIが単独で作り、AIが単独で回す人事評価制度は、2026年時点では高い確率で機能不全を起こします。一方で、人間の判断を残した補助型の設計、つまり「AIは下書き・要約・検知・整合性チェック・評価根拠の整理を担当し、最終判断は管理職と人事が引き受ける」設計なら、一定の効果が確認されています。以下では、なぜそう言えるのかを、最新動向と論文ベースで整理します。

- 要点

- 2025年から2026年にかけての最新動向 まず何が変わったのか

- 結論を先取りすると AI単独では機能しにくい3つの理由

- 理由1 制度面ではすでに「高リスク」と見なされている

- 理由2 社員は「正しそう」かどうかだけでなく「人として扱われたか」を見る

- 理由3 AIは人間の評価バイアスを消すのではなく、別のバイアスを足しうる

- 理由4 何を評価特徴量に使うかで、公平性は大きく変わる

- 理由5 職場実装では、監視圧力と信頼の問題が避けられない

- 2026年時点で「機能する」と言える範囲 ここまでは有効

- 逆に「機能しない」設計は何か

- 研究と制度から逆算した、実務上の最低条件

- 2026年3月12日時点の最終結論

- 参考文献・参照先

要点

- 2026年2月27日公表の HRM 実務研究では、GenAI は HR 実務で広く使われ始めているものの、高影響な意思決定では利用が慎重であり、重大な人事判断を伴う業務では境界条件があると示されています。

- EU AI Act(Regulation (EU) 2024/1689)は、雇用関係におけるパフォーマンス評価、行動監視、昇進・契約条件に影響する AIを高リスク領域に位置づけています。これは制度面でも「完全自動の評価制度」が危険だと見なされていることを意味します。

- Scientific Reports 2024 は、AIによる評価は偏り認知だけでなく、尊重されていない、個別事情を見てもらえていないという感覚を生みやすいと報告しています。人事評価制度では、精度だけでなく納得感が重要です。

- International Journal of Information Management 2025 は、AI 推奨値が管理職の評価にアンカリング・バイアスを生みうることを示しました。AIを入れれば人間バイアスが消える、とは言えません。

- Cogent Business & Management 2025 は、社員は AI 評価に使う特徴量について、職務関連性が強い項目は比較的公正と見なす一方、人口統計属性や私的領域に近い情報には強い懸念を持つと示しています。

- OECD の職場調査では、AI は業務パフォーマンスや意思決定支援にプラス面がある一方、データ収集への不安、監視圧力、仕事強度の上昇も確認され、研修と労働者協議がより良い結果と結び付くとされています。

2025年から2026年にかけての最新動向 まず何が変わったのか

2024年までは、HR領域でのAI活用といえば採用、応募者スクリーニング、FAQ、研修教材生成といった比較的入りやすい領域が中心でした。ところが、2025年から2026年にかけては「評価コメントの下書き」「目標設定のたたき台」「評価理由の要約」「離職リスクや高業績予測の補助」など、パフォーマンス管理そのものへ AI が入り始めています。

ただし、この変化は「AIが評価制度を全面的に置き換えた」ことを意味しません。2026年2月27日公表の Generative Artificial Intelligence in HRM Practice: Patterns, Profiles, and Theoretical Insights は、英国と米国の HR 実務家 150 人調査に基づき、GenAI の利用先として職務分析・設計 52.7%、研修・育成 52.7%、採用・選抜 52.0%、パフォーマンス管理 40.7%を報告しています。一方で同研究は、結果が従業員に重大な影響を及ぼす「consequential decisions」では利用が抑制されると整理しています。これは、現場の実務家自身がすでに「使える場面」と「任せてはいけない場面」を分け始めていることを示します。

つまり最新トレンドは、全面自動化ではなく、リスクに応じた限定的な埋め込みです。AIは評価制度の周辺業務を強く支援し始めていますが、評価制度の中核である処遇判断、昇進、査定、懲戒、低評価判定を完全自動に委ねる方向には進んでいません。

結論を先取りすると AI単独では機能しにくい3つの理由

- 法的・制度的に高リスクだから: 雇用評価は生活、昇進、契約条件、将来の機会に直接影響します。

- 人間が納得しにくいから: 評価制度は数値の正しさだけでなく、尊重、公平感、説明可能性で成立します。

- 人間のバイアスを消すどころか、別のバイアスを誘発するから: AI 推奨値に引きずられる、入力特徴量が不適切、監視が過剰、といった新しい歪みが入ります。

理由1 制度面ではすでに「高リスク」と見なされている

EU AI Act の最終法文である Regulation (EU) 2024/1689 は、雇用・労務管理における AI のうち、採用・選抜、契約条件への影響、昇進・終了、個人特性に基づくタスク配分、労働者のパフォーマンスや行動の監視・評価に使われるものを高リスクとして扱っています。前文では、こうした AI が将来のキャリア、生活、労働者の権利に重大な影響を及ぼしうると明示しています。

この点は非常に重要です。なぜなら、最新の制度環境はすでに「評価制度は便利だから自動化してよい」ではなく、「権利侵害や差別を起こしうるので強い統制が必要」という前提に立っているからです。人事評価制度は給与改定、昇進、育成投資、配置転換、退職勧奨などに連動しやすいため、単なる事務効率化ツールとは扱いが違います。

したがって、AIが生成した評価制度が一見きれいに見えても、説明責任、記録、検証、異議申立て、人間の見直しがない設計は、2026年時点の規制トレンドと整合しません。

理由2 社員は「正しそう」かどうかだけでなく「人として扱われたか」を見る

人事評価制度は、営業予測や在庫最適化と違って、対象が「人」です。だから制度が機能するかどうかは、予測精度や処理速度だけでは決まりません。被評価者が、評価過程で尊重された、個別事情を考慮された、説明の機会があったと感じるかが決定的に重要です。

Scientific Reports 2024 に掲載された What algorithmic evaluation fails to deliver: respectful treatment and individualized consideration は、AI による評価は、人間による評価に比べて、偏りへの懸念だけでなく「尊重されていない」「自分の細かな事情が考慮されていない」感覚を強く生むと示しました。論文の重要点は、問題が単に「AIは偏るかもしれない」だけではなく、評価そのものが非人格的に感じられることにあります。

これは人事評価制度にとって致命的です。たとえ統計的に一定の整合性があっても、社員が制度を冷たい、機械的だ、事情を見ないと受け取れば、制度の受容性は崩れます。受容性が崩れれば、評価面談、目標設定、育成計画、改善提案といった運用全体が機能しにくくなります。

理由3 AIは人間の評価バイアスを消すのではなく、別のバイアスを足しうる

AI導入の説明ではしばしば「人間の主観を減らして評価を客観化できる」と言われます。しかし最新研究は、AI 推奨値そのものが人間を引っ張ることを示しています。

International Journal of Information Management 2025 の How was my performance? Exploring the role of anchoring bias in AI-assisted decision making は、775人の管理職を用いた実験で、AI 推奨がパフォーマンス評価にアンカリング・バイアスを与えることを示しました。つまり、管理職は AI の示した初期値や方向性に引きずられうるのです。論文はさらに、consider-the-opposite のような意図的なデバイアス手法が必要だとしています。

この含意は大きいです。AI を入れても、評価者が AI を過信すれば、主観の代わりにAI起点の主観が入るだけです。しかもそのバイアスは、本人に自覚されにくい可能性があります。したがって、AI が作成した評価スコアやコメントをそのまま採用する制度は、見た目の一貫性に反して、実務上は危うい設計です。

理由4 何を評価特徴量に使うかで、公平性は大きく変わる

AI評価制度は、モデルそのものよりも、何を入力に使うかで品質が大きく変わります。打鍵数、ログイン時間、メール反応速度、会議発言回数、上司コメント、社内SNS、研修履歴、資格、経歴、異動歴など、使えるデータは多い一方で、それが妥当かどうかは別問題です。

Cogent Business & Management 2025 の Employees’ perceptions of the fairness of AI-based performance prediction features は、306人の従業員調査から、社員は職務成果との関連が明確な特徴量には比較的公正感を持つ一方で、人口統計属性、私生活や人格に近い特徴、差別やプライバシーに結びつく情報には強い懸念を示すことを報告しました。

これは実務に直結します。AIが評価制度を自動生成すると、見た目は整ったスコアリング項目が大量に出てきます。しかし、その中に説明しにくい代理変数や、特定の属性に不利な特徴量が紛れ込むと、制度全体が不公正になります。つまり、AIが制度を「作れる」ことと、その制度が「運用に耐える」ことはまったく別です。

理由5 職場実装では、監視圧力と信頼の問題が避けられない

OECD の AI 職場調査は、AI利用者の多くが業務パフォーマンスの改善を報告し、意思決定支援も前向きに受け止めている一方で、データ収集に伴うプライバシー不安、過度な監視、仕事のペース上昇も確認しています。特に OECD Employment Outlook 2023 は、アルゴリズム管理が仕事の強度を上げるリスクを持つと整理しています。また、別の OECD 作業報告では、研修と労働者への協議がより良い結果と結び付くとされています。

この知見を人事評価制度に当てはめると、問題はかなり明確です。AI評価制度が大量の行動ログを吸い上げ、本人に十分な説明もなく低評価予測や要注意フラグを出すと、制度は改善支援ではなく監視装置として受け取られます。そうなると、現場は制度を信頼せず、入力データの歪み、形骸化した面談、自己防衛的な行動が増えやすくなります。

つまり AI評価制度の成否は、モデル精度だけでなく、職場の信頼構造を壊さずに導入できるかにかかっています。

2026年時点で「機能する」と言える範囲 ここまでは有効

ここまで述べたように、完全自動の評価制度は危険です。しかし、だからといって AI が無価値ということではありません。最新研究と実務動向を総合すると、AI が比較的機能しやすいのは低リスクまたは中リスクの補助業務です。

|

領域 |

AIに向く役割 |

人間が残すべき役割 |

|---|---|---|

|

目標設定 |

SMART目標のたたき台作成、過去目標との整合性確認 |

職務文脈の反映、目標難易度の調整、最終合意 |

|

評価コメント |

実績要約、文面の標準化、根拠候補の整理 |

背景事情の反映、表現の妥当性判断、最終コメント承認 |

|

進捗把握 |

ログや成果物の要約、異常値検知、未入力警告 |

異常の理由確認、配慮事項の反映、対話実施 |

|

育成支援 |

弱点傾向の整理、学習提案、面談論点の提示 |

本人意向の確認、配置方針決定、育成責任 |

|

制度監査 |

部門別偏差の検出、文言のばらつき確認、ルール逸脱検知 |

是正判断、説明責任、制度変更の決裁 |

要するに、AI が機能するのは評価の「材料整理」と「均質化」までです。最終的な査定、昇進、降格、報酬、改善指導の決定まで AI に渡すと、研究が示しているリスクが一気に表面化します。

逆に「機能しない」設計は何か

- 評価理由が説明できない: なぜそのスコアになったのかを上司も人事も言語化できない。

- 特徴量の正当性を検証していない: 勤務ログやコミュニケーション量を安易に成果代理にしている。

- 異議申立ての経路がない: 本人が訂正や補足を出せない。

- 部門差・職種差を吸収していない: 営業、開発、管理部門で同じ信号を同じ重みで見ている。

- AI出力を管理職がそのまま採用する: 実質的に自動判定だが、責任だけ人間名義になっている。

- 監視データの収集範囲が広すぎる: 信頼を損ない、制度への反発を招く。

研究と制度から逆算した、実務上の最低条件

- 用途を限定する: まずは下書き、要約、アラート、監査から始める。

- 高影響判断には必ず human-in-the-loop を置く: 昇進、降格、賞与、低評価確定は人間が再判断する。

- 特徴量レビューを実施する: 何を使い、何を使わないかを文書化する。

- 異議申立てと修正プロセスを作る: 被評価者が補足事情を提出できるようにする。

- 監査指標を持つ: 部門別、性別、年齢層別、雇用形態別の偏りを定期点検する。

- 評価者訓練を行う: AI 推奨値への過信、アンカリング、説明不足を防ぐ。

- 導入前に労使・現場協議を行う: OECD が示す通り、協議と訓練は実装結果を左右します。

2026年3月12日時点の最終結論

本当にAIが作った人事評価制度は機能するのか。答えは、「補助制度としては機能しうるが、評価の中核を単独で担わせると機能しにくい」です。

この結論は、単なる慎重論ではありません。2026年の HRM 実務研究は、GenAI の活用が広がっていても重大な人事判断では利用が限定されることを示しています。2025年の実験研究は、AI 推奨が評価を歪めうることを示しました。2024年の行動研究は、AI評価が社員に尊重の欠如として受け止められうることを示しました。EU AI Act は、雇用評価 AI を高リスクに分類しています。これらを総合すると、AI単独の評価制度は、制度面・心理面・運用面の3方向で脆いと言えます。

したがって、2026年時点で現実的かつ有効なのは、AIが評価制度を作るのではなく、AIに制度運用を補助させる設計です。AIに任せるべきなのは、文章生成、情報整理、整合性チェック、異常検知、監査補助です。任せてはいけないのは、本人の将来を左右する最終評価の確定です。人事評価制度は、精度だけでなく、説明、尊重、異議申立て、公平感まで含めて初めて機能します。そこまで含めると、2026年の答えは明確です。AIだけで作った人事評価制度は、まだ単独では完成しません。

参考文献・参照先

- Melão, N. & Reis, J., Generative Artificial Intelligence in HRM Practice: Patterns, Profiles, and Theoretical Insights, Administrative Sciences, published 2026-02-27

- Regulation (EU) 2024/1689, Artificial Intelligence Act

- Chun, J. S. et al., What algorithmic evaluation fails to deliver: respectful treatment and individualized consideration, Scientific Reports, published 2024-10-29

- Carter, L. & Liu, D., How was my performance? Exploring the role of anchoring bias in AI-assisted decision making, International Journal of Information Management, 2025

- Majrashi, K., Employees’ perceptions of the fairness of AI-based performance prediction features, Cogent Business & Management, published 2025-01-22

- Lane, M., Williams, M. & Broecke, S., The impact of AI on the workplace: Main findings from the OECD AI surveys of employers and workers, OECD, published 2023-03-27

- OECD Employment Outlook 2023, Artificial intelligence, job quality and inclusiveness

- Naoum, R. F., Szakadáti, T. & Balogh, G., Artificial Intelligence (AI) in human resource management (HRM): a systematic review of its dual impact on diversity, equity, and inclusion (DEI), Management Review Quarterly, published 2026-01-08

コメント